Một báo cáo mới cho biết, quân đội Israel đã sử dụng một hệ thống AI để đưa những kẻ bị cáo buộc là khủng bố Hamas vào “danh sách tiêu diệt”, dẫn đến cái chết của dân thường gồm phụ nữ và trẻ em.

Báo cáo trích dẫn sáu sĩ quan tình báo Israel thừa nhận đã sử dụng AI có tên là “Lavender” để phân loại tới 37.000 người Palestine vào danh sách nghi là chiến binh Hamas - đánh dấu những người này và nhà của họ như mục tiêu được chấp nhận cho các cuộc không kích.

Israel đã kịch liệt phủ nhận vai trò của AI và người phát ngôn của quân đội nước này mô tả hệ thống Lavender là “công cụ phụ trợ giúp các sĩ quan trong quá trình buộc tội”.

Theo báo cáo, Lavender đã được đào tạo dựa trên dữ liệu từ việc giám sát dân số Palestine kéo dài hàng thập kỷ của tình báo Israel, sử dụng dấu vết kỹ thuật số của các chiến binh Hamas làm mô hình tìm kiếm. Các nguồn tin tình báo lưu ý rằng các sĩ quan đã quét từng mục tiêu do AI chọn trong khoảng “20 giây” trước khi “đóng dấu” phê duyệt, mặc dù một nghiên cứu nội bộ đã xác định rằng cứ 10 lần nhận dạng thì Lavender AI nhận dạng sai 1 lần.

Họ cho biết, các quyết định của Lavender được sử dụng để lập kế hoạch không kích vào ban đêm những ngôi nhà nơi các chiến binh bị tình nghi và gia đình họ, với các hướng dẫn cho phép giết chết 15 đến 20 thường dân như là “thiệt hại phụ” cho mỗi mục tiêu chiến binh cấp thấp. Trong trường hợp “chỉ huy lữ đoàn” của Hamas, con số có thể lên đến 100 người.

Theo các phóng viên của tạp chí +972 và Local Call, những người cộng tác trong báo cáo điều tra, việc phê duyệt để Lavender soạn thảo danh sách tiêu diệt chính thức của Lực lượng Phòng vệ Israel (IDF) bắt đầu chỉ hai tuần sau cuộc chiến vào tháng 10/2022.

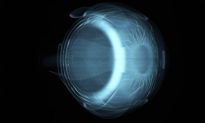

Phần mềm của Lavender AI lấy thông tin từ Đơn vị 8200, cơ quan giám sát hàng loạt người Palestine kéo dài hàng thập kỷ của Israel, bao gồm cả 2,3 triệu cư dân ở Dải Gaza, để chấm điểm từng người theo thang điểm từ 1 đến 100 về khả năng họ trở thành chiến binh Hamas hoặc các thành viên Jihad Hồi giáo Palestine (PIJ).

AI đã được đào tạo trên các chiến binh đã biết, xác định dấu hiệu tương tự với dữ liệu về các chiến binh như “đặc trưng” góp phần vào điểm số cao. Các hành động như tham gia nhóm WhatsApp, từng được ghi nhận của một chiến binh Hamas, là một trong số “hàng nghìn” tiêu chí được thêm vào thang điểm từ 1 đến 100 của một người.

Một sĩ quan tình báo cấp cao của Israel, có tên gọi là “B.” cho biết: “Vào lúc 5 giờ sáng, [Không quân Israel] sẽ đến và ném bom tất cả những ngôi nhà mà chúng tôi đã đánh dấu. Chúng tôi đã hạ gục hàng nghìn người. Chúng tôi không xem xét từng người một - chúng tôi đưa mọi thứ vào hệ thống tự động, và ngay khi một trong những [cá nhân được đánh dấu] ở nhà, anh ta ngay lập tức trở thành mục tiêu. Chúng tôi đã đánh bom anh ta và nhà anh ta”.

Một nguồn tin khác cho biết: “Điều rất ngạc nhiên đối với tôi là khi chúng tôi được yêu cầu ném bom một ngôi nhà để giết một người lính bộ binh, người mà tầm quan trọng của họ trong cuộc chiến rất thấp”.

Một nguồn tin tình báo đã đích thân chứng thực rằng họ đã cho phép đánh bom “hàng trăm” nhà riêng của những thành viên được cho là cấp dưới của Hamas hoặc các thành viên PIJ dựa trên chỉ định của Lavender AI.

Các nguồn tin tình báo cho biết, dữ liệu theo dõi điện thoại đã được chứng minh là một số liệu không đáng tin cậy được thuật toán của Lavender coi là hợp lệ.

Một quan chức tình báo cho biết: “Trong chiến tranh, người Palestine liên tục thay đổi điện thoại. Mọi người mất liên lạc với gia đình, đưa điện thoại cho bạn bè hoặc vợ, hoặc có thể mất nó. Không có cách nào có thể tin cậy 100% vào cơ chế tự động xác định số [điện thoại] nào thuộc về ai”.

Theo báo cáo của Bộ Y tế địa phương (MoH), số người chết ở Gaza do các chiến dịch ném bom của IDF và các phản ứng quân sự khác của họ đã tăng lên trên 30.000. Các báo cáo này đã được các nhà nghiên cứu y tế tại Johns Hopkins phân tích và xác nhận một cách nghiêm ngặt trong một bài viết trên tờ The Lancet, cùng với những người khác.

Các nhà nghiên cứu của Johns Hopkins đã so sánh những báo cáo về cái chết đó với thông tin công khai về các chiến dịch ném bom, dữ liệu điều tra dân số và phân tích từ Quỹ Dân số Liên Hợp Quốc cũng như hình ảnh vệ tinh từ Bản đồ Đường phố Mở của NASA để xác minh tính hợp lý của số liệu về số người chết.

Các nhà nghiên cứu cho biết: “Hệ thống báo cáo tử vong hiện đang được Bộ Y tế Palestine sử dụng đã được đánh giá vào năm 2021, hai năm trước cuộc chiến hiện tại và được phát hiện là báo cáo thấp hơn 13% tỷ lệ tử vong”.

Sử dụng số liệu riêng, Trường Y học Nhiệt đới và Vệ sinh Luân Đôn cũng đã xác nhận số người chết bằng hình ảnh vệ tinh bổ sung về các vụ đánh bom của IDF.

Vào tháng 10 năm ngoái, Israel đã phát động chiến dịch quân sự ở Gaza, một khu vực ven biển đông dân cư được tạo ra như một phần của cuộc xung đột lãnh thổ kéo dài hàng thập kỷ của Israel với cư dân Palestine.

Một cuộc tấn công khủng bố của Hamas vào ngày 7/10/2023, nhắm vào Lễ hội âm nhạc Nova gần khu định cư Re'im, đã cướp đi sinh mạng của khoảng 1.200 người Israel cùng với các con tin.

Cuộc xung đột tàn khốc sau đó đã dẫn đến lời kêu gọi của Hội đồng Bảo an Liên Hợp Quốc về ngừng bắn ngay lập tức, tiến hành tố tụng tội ác chiến tranh tại Tòa án Công lý Quốc tế ở La Hay, và kêu gọi rộng rãi về một giải pháp nhanh chóng và hòa bình hơn.

Theo Daily Mail